Blog

Aspectos clave sobre las evaluaciones de conformidad en virtud de la Ley de IA de la UE

¿Qué son las evaluaciones de conformidad? ¿Quién se encarga de estas evaluaciones y cuál es su importancia? Obtén más información sobre estas evaluaciones y sobre cómo se relacionan con tu programa de gobernanza de la IA.

Diethelm de Lauren

Especialista en marketing de contenido de IA

20 de noviembre de 2023

El borrador de la Ley de IA de la UE adopta un enfoque preventivo y que se basa en el riesgo de la IA, y para ello ha establecido cuatro categorías de riesgo diferentes donde se pueden clasificar los sistemas de IA. Estas categorías de riesgo están diseñadas para proteger la salud, la seguridad y los derechos humanos fundamentales de los individuos que entran en contacto con sistemas de IA.

No está prohibido el uso de los sistemas que están diseñados como de alto riesgo, pero sí cuentan con más requisitos que deben cumplirse antes de poder implementarse de cara al público, y uno de esos requisitos es someterse a una evaluación de conformidad.

Descarga la guía, que ha sido desarrollada en colaboración con el foro sobre el futuro de la privacidad, aquí .

¿Qué son las evaluaciones de conformidad?

El artículo 3 del borrador de la Ley de IA define las evaluaciones de conformidad como el proceso de verificar o demostrar que un sistema de alto riesgo cumple con ciertos requisitos dispuestos en esta legislación. Estos requisitos son:

- Sistema de gestión de riesgos

- Gobernanza de datos

- Documentación técnica

- Conservación de registros

- Transparencia y la provisión de la información

- Supervisión humana

- Precisión, robustez y ciberseguridad

Los proveedores de sistemas de IA de alto riesgo deben cumplir estos requisitos antes de que su sistema pueda comercializarse, al mismo tiempo que se protege a las personas frente a los posibles daños que supone un sistema de alto riesgo. Las evaluaciones de conformidad son herramientas clave en lo que respecta a la responsabilidad proactiva de los sistemas de alto riesgo, por lo que comprender cómo y dónde funcionan será igualmente clave para su programa de gobernanza de la IA.

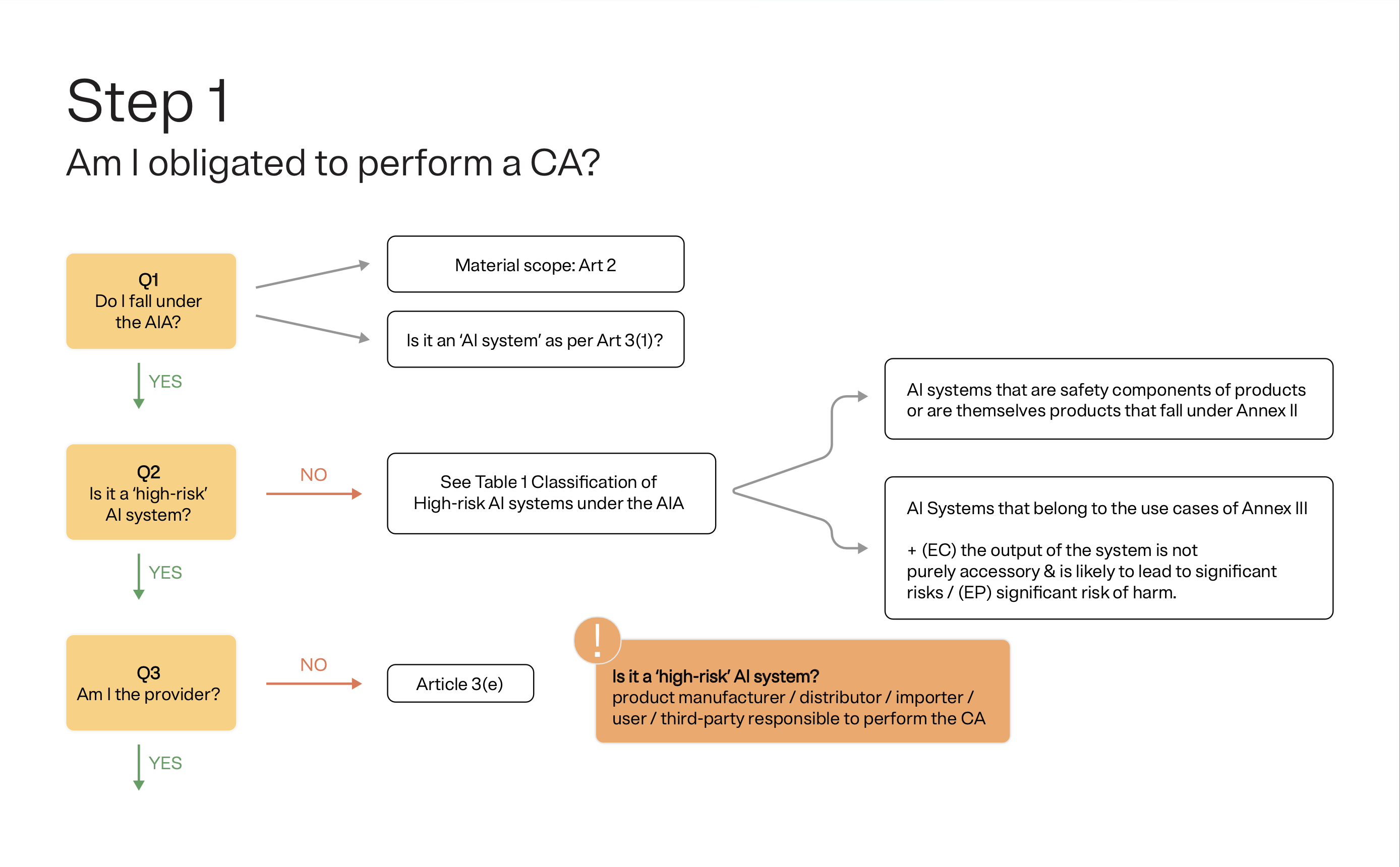

¿Necesito realizar una evaluación de conformidad?

Para saber si necesitas realizar una evaluación de conformidad o no antes debes de responder a varias preguntas. Así es como puedes determinar si realmente necesitas realizar una evaluación de conformidad:

En primer lugar, ¿te encuentras dentro de la jurisdicción de la Ley de IA? ¿Y el sistema que esperas utilizar se considera realmente un sistema de IA según el apartado 1 del artículo 3 de dicha ley? Si no es así, ya has terminado y no necesitas realizar una evaluación de conformidad. Lo mismo ocurre si tu sistema no se considera un sistema de alto riesgo. Solo los sistemas que se clasifican como de alto riesgo por la Ley de IA de la UE deben someterse a una evaluación de conformidad.

Descarga la infografía completa «Evaluación de conformidad de la Ley de IA de la UE: guía por pasos».

El otro factor determinante es tu función dentro del sistema. Si eres el proveedor del sistema o un actor responsable, entonces eres el responsable de realizar la evaluación de conformidad. Normalmente, el proveedor y el actor responsable serán la misma parte; sin embargo, hay ciertas excepciones donde el actor responsable es otra persona.

Los actores responsables pueden ser distribuidores, importadores, responsables del despliegue u otros terceros que utilicen la IA bajo su nombre o marca comercial. Aún no se han establecido los requisitos jurídicos exactos para los casos en que alguien que no sea el proveedor tenga que realizar la evaluación de conformidad.

¿Cuándo debo realizar una evaluación de conformidad?

Cuando determines que se requiere una evaluación de conformidad, tendrás que decidir cuándo. Existe una programación correcta sobre cuándo deben realizarse las evaluaciones de conformidad:

- Antes del suceso: La evaluación de conformidad debe realizarse antes de que el sistema de IA se comercialice en el mercado de la UE; es decir, antes de que se ponga a disposición del público.

- Después del suceso: Después de comercializar un sistema de alto riesgo, se requiere una nueva evaluación de conformidad si el sistema experiementara modificaciones sustanciales. Cabe destacar que esto no afecta a los cambios que se produzcan a medida que el sistema siga aprendiendo (tal y como hacen el resto de modelos) después de comercializarse; sino más bien, hace referencia a cualquier cambio que pudiera afectar de forma significativa el cumplimiento normativo del sistema para con los requisitos que haya medido la evaluación de conformidad.

¿Quién realiza las evaluaciones de conformidad?

Las evaluaciones de conformidad se pueden realizar o bien de forma interna o a través del proceso de un tercero. En base a cada nombre, se puede entender que las evaluaciones de conformidad internas las realiza el proveedor (o el actor responsable) mientras que las evaluaciones de conformidad de terceros las realiza un organismo externo al que se ha notificado.

El artículo 43 de la Ley de IA establece directrices más explícitas sobre qué casos requieren una evaluación de conformidad interna y cuáles deben pasar por un proceso de terceros. Asimismo, puedes consultar pasos más detallados para cada proceso en esta guía por pasos.

Cumple con los requisitos para los sistemas de alto riesgo

Tal y como se mencionó con anterioridad, las evaluaciones de conformidad tienen como objetivo verificar que los sistemas de alto riesgo cumplan con los siete requisitos que establece la Ley de IA: gestión de riesgos, gobernanza de los datos, documentación técnica, conservación de registros, obligaciones de transparencia, supervisión humana, y precisión, robustez y ciberseguridad.

A menos que se especifique lo contrario, todos estos requisitos deben cumplirse antes de que el sistema de IA se ponga en uso o entre en el mercado. Una vez que el sistema esté en uso, el proveedor también debe garantizar el cumplimiento continuo durante todo el ciclo de vida del sistema.

Al evaluar estos requisitos, debe tenerse en cuenta el propósito de uso previsto del sistema, al igual que el uso indebido que se pueda preveer de manera razonable de dicho sistema.

Utiliza esta guía para profundizar en cada uno de los diferentes requisitos y ver cómo se desarrolla el cumplimiento normativo y la implementación para cada uno de ellos.

También podría interesarte:

Seminario web

AI Governance

EU AI Act al descubierto: ¿qué hay nuevo?

Acompáñanos en este fireside chat con Rubén Jurado, Privacy Counsel, para hablar del Reglamento Europeo de IA y hacer un repaso de lo que ya está en marcha, lo que llega el próximo mes de mayo y en agosto de este año, y todo lo que supondrá para las organizaciones.

mayo 07, 2025

Documento técnico

AI Governance

Cómo poner en práctica la Ley de IA de la UE con OneTrust: manual de implementación

enero 02, 2025

Seminario web

AI Governance

Navegar el panorama normativo de la IA: Ley de IA de la UE y soluciones de gobernanza de la IA

Acompáñanos en este webinar para explorar juntos el panorama normativo actual de la inteligencia artificial, con especial atención a la Ley de IA de la UE que entró en vigor el pasado 1 de agosto. Además, durante el webinar se hará una demostración práctica de nuestra solución AI Governance, que mostrará cómo puedes ayudar a tu organización a optimizar tus procesos de gestión, documentación y análisis.

octubre 22, 2024

Documento técnico

IA responsable

Guía práctica de Inteligencia Artificial

¿Cómo puede tu organización crear un equipo de gobernanza de la IA que aborde las cuestiones de privacidad y, al mismo tiempo, desarrolle políticas y procedimientos que sigan cumpliendo la normativa mundial y los marcos de la IA? Nuestro guía práctica responde a esta pregunta y a otras más.